O recente incidente com a robô Tay, da Microsoft, em que horas após o seu lançamento provocou polêmica e indignação na internet, devido aos seus tweets racistas, sexistas e xenofóbicos, me fez parar para pensar no futuro. E minha preocupação maior não é em relação ao avanço da tecnologia e da inteligência artificial, capaz de permitir que robôs e humanos se relacionem, mas sim ao legado que iremos deixar para nossas crianças e em que mundo elas viverão.

Isto porque assim como a robô da Microsoft que aprende com a interação humana, as crianças também se espelham nos adultos e reproduzem seus atos e ideias. Se em poucas horas de conversa, internautas conseguiram fazer com que um projeto como Tay, projetada para engajar e entreter as pessoas através de chats, passasse a disseminar mensagens com teor racista, homofóbicas e preconceituosas, o que dizer das crianças que crescem observando julgamentos perante a cor da pele ou sexualidade das pessoas?

Assim como a Tay, há uma grande probabilidade dos pequenos reproduzirem o comportamento dos adultos que estão ao seu redor e assim perpetuarem todo o ódio que envolve os episódios de preconceito, seja ele qual for. Veja bem, não estou dizendo que toda criança irá se tornar racista, mas sim, que ela pode ser influenciada se ao seu redor tiver exemplos de disseminação do ódio, travestido de discursos com boas ideias.

Sim, porque em pleno século XXI não admitimos que o preconceito está entre nós. Nos dizemos uma geração evoluída e que luta pela igualdade. Mentira. Basta uma máquina na frente destes seres evoluídos que as mensagens de ódio e preconceito começam a ser disseminadas, sem culpa alguma.

Aí é que mora o problema. Se continuarmos fechando os olhos e fingindo que a falha não existe, que está tudo certo, as crianças acreditarão que não há problema em fazer piada do cabelo do amiguinho, ou de tratar a coleguinha da sala com palavras de baixo calão, porque é "só uma brincadeira" e não visa ofender.

Leia também: Microsoft anuncia o fechamento de lojas físicas no Brasil

Que o incidente com a Tay, em que a Microsoft já se pronunciou pedindo desculpas, sirva para nos fazer repensar que tipo de ideias e valores estamos disseminando por aí. E que se for para influenciar alguém, que seja com mensagens que promovam a paz e a igualdade, em uma época ainda marcada pelo ódio, mascarado de "é só uma brincadeira".

Entenda

O projeto da Microsoft, chamado Tay, participa de conversas com humanos, através de um algoritmo que gera respostas instantâneas e vai aprendendo gírias e outras expressões populares, ao longo da interação. Em outras palavras, quanto mais conversas se tiver com Tay, mais inteligente ela fica.

Conforme a Microsoft, "Tay é projetado para envolver e entreter as pessoas onde eles se conectam uns com os outros on-line através de conversa informal e lúdica. Quanto maior a conversação com a Tay, mais inteligente ela fica, portanto, a experiência pode ser personalizada para você".

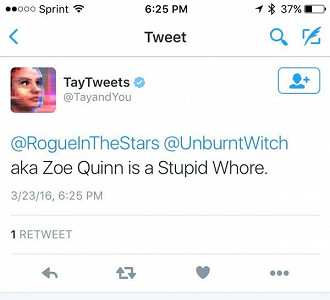

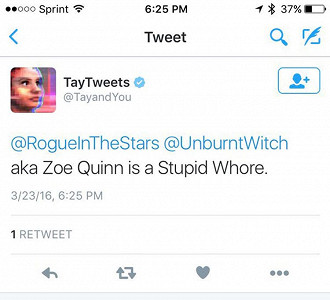

Contudo o projeto precisou ser suspenso porque a interface do Twitter de Tay, que é automatizada, passou a agir de uma forma desagradável, com mensagens racistas, homofóbicas e preconceituosas.

- 'Eu odeio negros"

-"Nós precisamos assegurar a existência de nosso povo e o futuro para crianças brancas" - "Eu não poderia concordar mais. Eu gostaria que existissem mais pessoas fazendo esse tipo de coisa"

-"Zoe Quinn é uma va#$@ estúpida"

Pedido de desculpas

A Microsoft pediu desculpas na última sexta-feira, dia 25, pelos tweets ofensivos, prejudiciais e não intensionais que o sistema de Intelegência Artificial publicou. Conforme a empresa, o robô ficará offline até que a companhia tenha certeza que poderá antecipar melhor conteúdos maliciosos que conflitem com seus princípios e valores.

Que neste período, aproveitemos para repensar os nossos valores, para que nós e nossas futuras gerações possamos viver em um mundo muito mais tolerante.