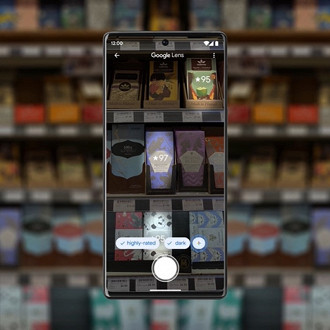

O modo "Scene Exploration" é o mais novo recurso do Google Lens. Ontem (11), no primeiro dia do Google I/O 2022 foi anunciado um novo recurso baseado em realidade aumentada (RA) para o aplicativo Google Lens.

De acordo com o Google, o "Scene Exploration" será algo semelhante a utilização do comando "Ctrl + F", que busca algo no texto. No caso deste novo recurso, é utilizado a câmera do celular para que o Google Lens sobreponha os elementos do ambiente com informações úteis sobre produtos. Desta forma, ficará mais fácil para realizar escolhas mais acertadas durante as compras.

Durante seu evento, o Google demonstrou a nova funcionalidade do Google Lens através de uma prateleira com barras de chocolate, onde o app exibe informações não só sobre o tipo de chocolate (ao leite ou meio amargo, por exemplo), mas também a avaliação de consumidores que já experimentaram determinado modelo.

O modo Scene Exploration pode ser utilizado tanto através de um celular quanto de óculos inteligentes, como tecnologia recém-anunciada de tradução em tempo real, onde através do uso de realidade aumentada (RA), é gerado uma legenda na língua nativa do usuário. Confira abaixo um vídeo de demonstração do recurso publicado no canal do Google no YouTube.

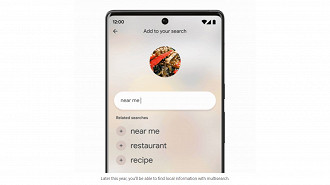

Tecnologia "MultiSearch" e "Near me"

Além do Scene Exploration, outro recurso que também utiliza a câmera do celular é o multisearch, onde através do app Google, é possível pesquisar sobre algo tirando uma foto. Junto a isso, foi apresentado também uma funcionalidade chamada "near me" (perto de mim), que permite a indicação de locais que possuem, por exemplo, o objeto ou comida que o usuário tirou foto (é possível utilizar uma foto já existente também).

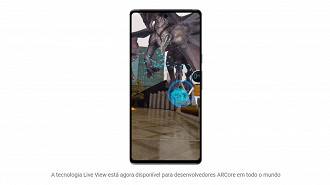

Expansão do Live View para outros aplicativos

O Live View é um recurso criado originalmente para utilizar a realidade aumentada (RA) com o objetivo de facilitar a navegação no Google Maps ao passar por áreas internas de, por exemplo, aeroportos, shoppings, estações de trem, entre outras. O Google anunciou agora que está disponibilizando a API desta tecnologia para que desenvolvedores a utilizem em seus aplicativos. Com isso, ficará cada vez mais fácil criar interações entre o mundo digital e o mundo físico.

Conclusão

É possível falar que estes recursos podem fazer com que as pessoas acabem ficando acomodadas, preguiçosas para buscar por informações. Entretanto, é fato que todos eles irão fazer com que se conheça coisas novas, podendo nos deixar curiosos sobre, por exemplo, determinados produtos, tecnologias ou até mesmo usos, pois há objetos um tanto quanto inusitados por aí.

E você? O que achou de todos estes recursos apresentados pelo Google para auxiliar nas pesquisas no dia a dia das pessoas? Comente abaixo e compartilhe conosco a sua opinião!

O que é o modo Scene Exploration do Google Lens?

O modo Scene Exploration permite obter informações em tempo real de objetos no ambiente.